- ავტორი Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:49.

- ბოლოს შეცვლილი 2025-06-01 05:09.

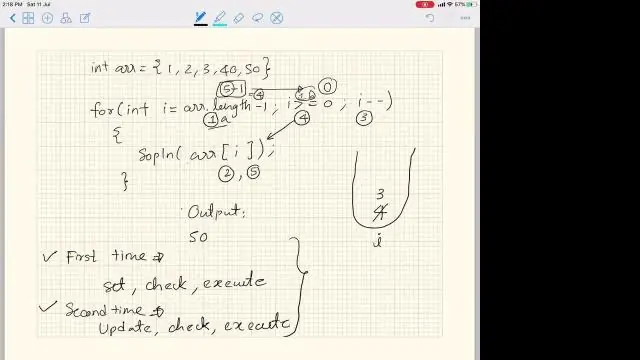

დოკუმენტაციიდან: CLASS ჩირაღდანი. nn . ხაზოვანი (in_features, out_features, bias=True) ვრცელდება ა ხაზოვანი ტრანსფორმაცია შემოსულ მონაცემებზე: y = xW^T + b. პარამეტრები: in_features - თითოეული შეყვანის ნიმუშის ზომა.

ანალოგიურად, ისმის კითხვა, როგორ მუშაობს NN წრფივი?

ხაზოვანი . ვრცელდება ა ხაზოვანი ტრანსფორმაცია შემოსულ მონაცემებზე, ანუ //y= Ax+b//. შეყვანის ტენსორი, რომელიც მოცემულია წინ (შეყვანისას) უნდა იყოს ან ვექტორი (1D ტენსორი) ან მატრიცა (2D ტენსორი). თუ შეყვანა არის მატრიცა, მაშინ თითოეული მწკრივი ჩაითვლება მოცემული პარტიის შეყვანის ნიმუშად.

ანალოგიურად, რა არის conv2d PyTorch-ში? conv2d (შეყვანა, წონა, თვითმმართველობა. მიკერძოება, თვითმმართველობა. ნაბიჯი, თვით. შეფუთვა, თვით. გაფართოება, თვით.

მეორეც, რა არის PyTorch nn?

PyTorch : nn The nn პაკეტი განსაზღვრავს მოდულების ერთობლიობას, რომელიც შეგიძლიათ წარმოიდგინოთ, როგორც ნერვული ქსელის ფენა, რომელიც აწარმოებს გამოსავალს შეყვანისგან და შეიძლება ჰქონდეს გარკვეული სავარჯიშო წონა. იმპორტის ჩირაღდანი # N არის სურათების ზომა; D_in არის შეყვანის განზომილება; # H არის ფარული განზომილება; D_out არის გამომავალი განზომილება.

როგორ იყენებთ ReLU-ს PyTorch-ში?

In PyTorch , შეგიძლიათ ააწყოთ ა ReLU ფენა გამოყენებით მარტივი ფუნქცია relu1 = nn. ReLU არგუმენტით inplace=False. მას შემდეგ, რაც ReLU ფუნქცია გამოიყენება ელემენტის მიხედვით, არ არის საჭირო შეყვანის ან გამომავალი ზომების მითითება. არგუმენტი inplace განსაზღვრავს, თუ როგორ ექცევა ფუნქცია შეყვანას.

გირჩევთ:

რა არის წრფივი და არაწრფივი მონაცემთა სტრუქტურაში?

1. მონაცემთა ხაზოვანი სტრუქტურაში მონაცემთა ელემენტები განლაგებულია წრფივი თანმიმდევრობით, სადაც თითოეული ელემენტი მიმაგრებულია მის წინა და მომდევნო მიმდებარედ. მონაცემთა არაწრფივი სტრუქტურაში მონაცემთა ელემენტები მიმაგრებულია იერარქიულად. მონაცემთა ხაზოვანი სტრუქტურაში, მონაცემთა ელემენტების გადაადგილება შესაძლებელია მხოლოდ ერთი გაშვებით

წრფივი ძიება იგივეა, რაც თანმიმდევრული ძიება?

კლასი: ძიების ალგორითმი

რა არის w3c რა არის Whatwg?

Web Hypertext Application Technology Working Group (WHATWG) არის HTML და მასთან დაკავშირებული ტექნოლოგიების განვითარებაში დაინტერესებული ადამიანების საზოგადოება. WHATWG დაარსდა Apple Inc.-ის, Mozilla Foundation-ის და Opera Software-ის, წამყვანი ვებ ბრაუზერების მომწოდებლების მიერ 2004 წელს

რომელი მოდელი აერთიანებს წრფივი და პარალელური პროცესის ნაკადების ელემენტებს?

ინკრემენტული მოდელი აერთიანებს წრფივი და პარალელური პროცესის ნაკადების ელემენტებს. თითოეული წრფივი თანმიმდევრობა აწარმოებს პროგრამული უზრუნველყოფის მიწოდების "ნამატებს" ისე, რომ მსგავსია ევოლუციური პროცესის ნაკადის მიერ წარმოებული ნამატები

რა არის conv2d PyTorch-ში?

Conv2d(შეყვანა, წონა, თვითმმართველობა. მიკერძოება, თვით. ნაბიჯი, თვით. შეფუთვა, თვით. გაფართოება, თვით